ここ数年でAIは驚異的な進化を遂げましたが、2026年の今、その主戦場は画面の中から現実世界へと大きく広がっています。文章を書くAIや画像を生成するAIに触れてきた方ほど、「次は何が起きるのか」と感じているのではないでしょうか。

実は今、AIはロボットという“身体”を得て、工場や物流倉庫、介護施設、さらには家庭の中にまで入り込み始めています。視覚・言語・行動を統合するフィジカルAIの登場により、ロボットは単なる自動機械ではなく、自律的に判断し行動する存在へと進化しました。

特に日本では、少子高齢化や労働力不足といった課題を背景に、フィジカルAIの社会実装が急速に進んでいます。ヒューマノイドロボットの実運用、製造・物流の自律化、介護や医療現場での活用など、その変化はすでに現実のものです。

本記事では、2026年時点での最新データや具体的な導入事例、政策やインフラの動向を整理しながら、フィジカルAIが私たちの社会や働き方をどこまで変えたのかをわかりやすく解説します。AIに関心のある方が、次の時代を理解するための視点を得られる内容をお届けします。

フィジカルAIとは何か、2026年時点での定義

フィジカルAIとは、大規模言語モデルや視覚モデルを中核とする知能が、ロボットなどの物理的な身体を通じて現実世界に直接作用するAIを指します。2026年時点では、単なるロボット制御や自動化とは明確に区別され、「環境を理解し、自ら判断し、行動の結果を学習に反映する」という循環を持つ知能として定義されるようになっています。

世界経済フォーラムによれば、フィジカルAIの本質は、デジタル空間に閉じていたAIが物理法則、不確実性、人間との相互作用を前提とした世界に踏み出した点にあります。視覚、言語、行動を統合するビジョン・言語・アクションモデルの進化により、ロボットは事前に細かくプログラムされていない状況でも、意味を理解して柔軟に振る舞えるようになりました。

従来の産業用ロボットが「決められた動作を正確に繰り返す機械」だったのに対し、フィジカルAIは目的達成のために行動を生成する主体です。例えば「この箱を安全に運んでください」という曖昧な指示に対して、周囲の障害物や箱の形状を認識し、最適な持ち方や経路を自律的に選択します。この点が2026年時点での決定的な違いです。

| 観点 | 従来のロボット | フィジカルAI |

|---|---|---|

| 判断の仕組み | 事前定義ルール | 基盤モデルによる推論 |

| 環境変化への対応 | 困難 | リアルタイムで適応 |

| 学習 | 限定的 | 実世界とシミュレーションから継続学習 |

国際ロボット連盟や複数の学術レビューでも、2026年はフィジカルAIが研究段階を越え、社会実装の入口に立った年と位置づけられています。数千万時間規模のシミュレーション学習と実環境データを組み合わせる手法が確立されたことで、未知の物体や初めての作業にも一定の成功率で対応できるようになりました。

重要なのは、フィジカルAIが「人間を完全に置き換える存在」としてではなく、人間の意図を理解し、身体労働や危険作業を担う協働パートナーとして設計されている点です。この思想は、日本政府のAI基本計画や人間中心のAI原則とも一致しており、2026年時点でのフィジカルAIの定義には、技術要素だけでなく社会との関係性まで含まれるようになっています。

VLAモデルの進化がロボットにもたらした変化

VLAモデルの進化は、ロボットの能力を質的に変化させました。従来のロボットは、視覚認識、言語理解、動作制御が別々のモジュールとして設計されており、想定外の状況では停止するか、人間の再設定を必要としていました。これに対してVLAモデルは、視覚・言語・行動を単一のニューラルネットワークで統合的に処理するため、現実世界の曖昧さや変化に対して柔軟に対応できるようになっています。

この変化を端的に示すのが、自然言語による指示理解です。「赤い箱を避けて、棚の奥にある部品を取る」といった曖昧で複合的な命令を、ロボットが自律的に解釈し、最適な関節動作へと変換できます。視覚情報と言語の意味が行動レベルで直結している点が、VLAモデルの本質的な強みです。

| 観点 | 従来型ロボット | VLAモデル搭載ロボット |

|---|---|---|

| 指示方法 | 事前定義されたコマンド | 自然言語による柔軟な指示 |

| 環境変化への対応 | 困難、再設定が必要 | リアルタイムで適応 |

| 未学習タスク | 原則不可 | 概念理解により対応可能 |

研究コミュニティでもこの転換は明確に認識されています。arXivやICLR 2026で報告されたVLA関連研究によれば、インターネット上の膨大な動画データを用いたクロスモーダル学習により、ロボットは「ドアを開ける」「物を渡す」といった動作概念を抽象化して獲得しています。その結果、初めて見る形状や配置であっても、人間に近い試行錯誤を行いながらタスクを完遂できるようになりました。

特に重要なのは、VLAモデルがロボットを「プログラムされる機械」から「状況を理解して判断する存在」へと変えた点です。これは製造業や物流だけでなく、介護や家庭内作業のような非定型環境での実用性を一気に高めています。

さらに2026年時点では、音声の抑揚や話し方のニュアンスを直接行動に反映するVLASの研究も進んでいます。文字起こしを介さず、声そのものを入力として扱うことで、人間とロボットのインタラクションはより直感的になりました。VLAモデルの進化は、ロボットに身体だけでなく、文脈理解という知能の核心を与えつつあります。

日本と世界におけるAI・ロボット市場の最新動向

2026年時点でのAI・ロボット市場は、日本と世界の双方で量的拡大と質的転換が同時に進行している局面にあります。従来はIT投資や省人化の文脈で語られることが多かったAI市場ですが、現在は実体経済に深く組み込まれ、製造能力や労働力そのものを左右する基盤産業へと進化しています。

日本市場に目を向けると、官民一体の投資が成長を強く後押ししています。TechSci Researchによれば、日本のAI市場規模は2024年に約75.6億ドルでしたが、2030年には268億ドルへ拡大し、年平均成長率は23%超と予測されています。特に注目すべきは生成AI分野で、ロボット制御コードの自動生成や仮想環境での学習データ生成といった用途拡張により、約40%近い高成長が見込まれています。

一方、世界市場ではロボティクスがAI需要を牽引しています。国際ロボット連盟によれば、世界の産業用ロボット年間導入数はすでに54万台を超え、2028年には70万台規模に達する見通しです。日本は中国に次ぐ世界第2位の産業用ロボット大国として、稼働台数45万台超を維持しており、成熟市場でありながら高付加価値化が進む点が特徴です。

| 市場区分 | 直近規模 | 将来予測 |

|---|---|---|

| 日本AI市場全体 | 約75.6億ドル(2024年) | 268億ドル(2030年) |

| 日本生成AI市場 | 約13.5億ドル | 約180億ドル(推計) |

| 世界物流ロボット市場 | 約104.5億ドル | 320億ドル超(2031年) |

世界的には、物流ロボットや自律移動ロボットを中心に、ロボット市場がAI市場と融合する形で拡大しています。QYResearchの分析では、物流ロボット市場は2031年までに約3倍へ成長するとされ、EC拡大と人手不足が同時進行する地域ほど導入が加速しています。アマゾンなどの事例では、AIとロボットの統合により配送効率が20%以上改善したと報告されています。

日本と世界の決定的な違いは、導入目的にあります。欧米ではコスト削減とスケール拡大が主眼であるのに対し、日本では少子高齢化を背景に社会維持そのものを支える市場としてAI・ロボットが位置付けられています。この構造的需要の存在が、日本市場を短期トレンドではなく、中長期で持続的に成長する市場へと押し上げているのです。

ヒューマノイドロボットが実用段階に入った理由

ヒューマノイドロボットが実用段階に入った最大の理由は、知能・身体・環境の三要素が同時に臨界点を超えたことにあります。これまでのロボットは、決められた動作を繰り返す存在に留まっていましたが、2026年現在は人間のように状況を理解し、判断し、動く能力が現実の現場で通用する水準に到達しています。

まず決定的だったのが、VLAモデルに代表される基盤AIの進化です。視覚、言語、行動を単一モデルで統合することで、ロボットは事前に細かくプログラムされていない環境でも対応できるようになりました。国際会議ICLRやarXivで報告されている研究によれば、インターネット動画と実機データを組み合わせた学習により、未経験の物体操作成功率が飛躍的に向上しています。これが「汎用性」という壁を初めて現実的なものにしました。

加えて、ハードウェアの信頼性向上も見逃せません。アクチュエータの耐久性、バッテリー効率、触覚センサーの精度が大幅に改善され、長時間の連続稼働が可能になりました。Figure AIが公表したBMW工場での実証では、約11か月間で1,250時間以上稼働し、9万点以上の部品を扱っています。これは研究用途ではなく、明確に生産計画に組み込める水準です。

| 要因 | 従来 | 2026年時点 |

|---|---|---|

| 知能 | ルールベース中心 | VLA基盤モデルによる自律判断 |

| 身体 | 短時間・限定動作 | 20時間超の連続稼働と高精度操作 |

| 環境適応 | 専用設備が必要 | 人間向け環境をそのまま利用 |

さらに重要なのが、シミュレーション技術の成熟です。NVIDIAや世界経済フォーラムが指摘するように、デジタルツイン上で数千万時間規模の仮想訓練を行い、現実世界に即時反映する手法が一般化しました。これにより導入前の不確実性が大幅に減少し、企業が「試験導入」から「本配備」へ踏み切れるようになっています。

経済合理性も実用化を後押ししています。ロボット・アズ・ア・サービスモデルの普及により、初期投資を抑えた導入が可能になりました。人手不足が深刻な製造・物流分野では、採用難や離職リスクを抱える人件費と比較して、ヒューマノイドの方が中長期的に安定するという判断が広がっています。IMFや国際ロボット連盟も、労働力補完としての実効性を評価しています。

そして最後に、社会的受容の変化があります。日本を中心に、人型であること自体が現場との親和性を高めています。人間向けに設計された通路、工具、作業台をそのまま使える点は、環境改修コストを抑えるだけでなく、現場スタッフとの協働を円滑にします。技術的成熟と心理的受容が重なったことで、ヒューマノイドロボットはついに「使える存在」として現実社会に定着し始めています。

製造業・物流で進む自律化とエージェンティックAI

製造業・物流の現場では、2026年を境に自動化から自律化へと質的な転換が進んでいます。その中心にあるのが、分析AIと生成AIを組み合わせ、状況判断から行動までを一気通貫で担うエージェンティックAIです。**もはや人が細かく指示を出す必要はなく、AI自身が目的を理解し、最適な手段を選択する段階に入っています。**

この変化を象徴するのが、ITとOTの本格的な融合です。国際ロボット連盟によれば、最新のスマートファクトリーでは生産管理システムとロボット制御がリアルタイムで連携し、ライン全体を一つの知能体として最適化する設計が主流になりつつあります。例えば需要変動を検知すると、AIが即座に工程順序やロボットの動線を再構成し、停止時間を最小化します。

世界経済フォーラムの分析では、デジタルツインを活用した仮想試運転により、設備導入までの期間が約40%短縮された事例も報告されています。**物理的な試行錯誤をAIが仮想空間で肩代わりすることで、現場は「学習済みの状態」から稼働を始められる**点が大きな価値です。

| 領域 | 従来の自動化 | 自律化後の特徴 |

|---|---|---|

| 生産制御 | 固定ルール | AIが動的に再計画 |

| 保全 | 事後対応 | 数週間前に予兆検知 |

| 物流搬送 | 決め打ちルート | 混雑を避けて自律判断 |

物流分野でも変化は顕著です。AI駆動の自律移動ロボットは、不規則な棚配置や人の動きを認識しながら、最短かつ安全な経路をその場で判断します。アマゾンなどの先行企業では、エージェンティックAIの導入によって配送効率が25%向上し、運営コストが15%削減されたと報告されています。

注目すべきは、ロボット・アズ・ア・サービスの普及です。月額課金で最新の自律ロボットを使えるため、中小企業でも高度な自律化に踏み出せるようになりました。**自律化は大企業だけの特権ではなく、産業全体の競争条件を変え始めています。**

この流れは労働の意味も変えています。人は監督や改善、例外対応に集中し、AIは判断と実行を担う。製造業・物流におけるエージェンティックAIは、単なる省人化ではなく、現場の知能そのものを底上げする存在として定着しつつあります。

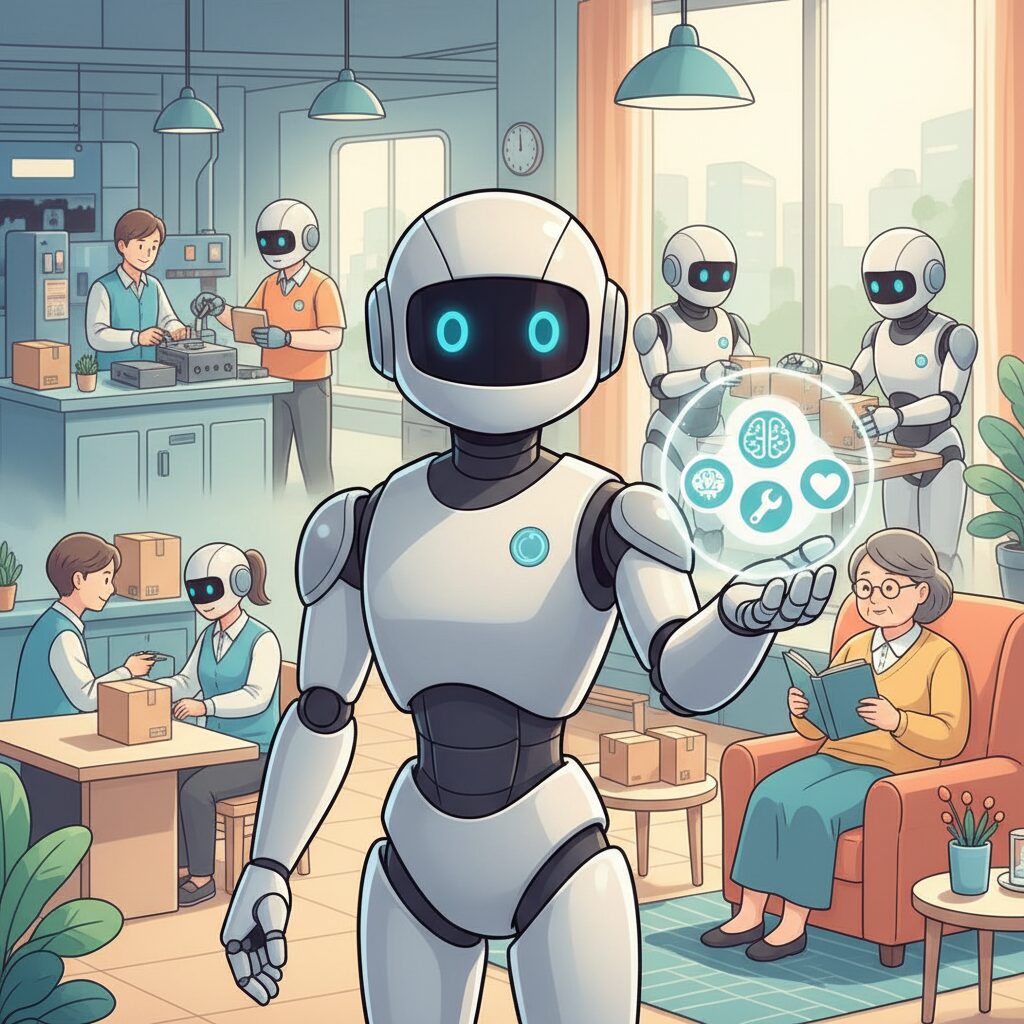

介護・医療分野で進むフィジカルAIの社会実装

介護・医療分野では、フィジカルAIの社会実装がすでに実証段階を超え、現場運用を前提としたフェーズに入っています。背景にあるのは、日本の急速な高齢化と深刻な人材不足です。厚生労働省の推計では、2040年までに介護人材が約28%不足するとされており、この構造的課題に対する現実解として、身体性を持つAIへの期待が高まっています。

象徴的な取り組みが、内閣府のムーンショット型研究開発事業で進められている介護支援ロボットAIRECです。AIRECは150kg級の出力を持ちながら、要介護者の体位変換や着替えを安全に行える繊細な力制御を実現しています。これは熟練介護士の動作データをAIに学習させ、NVIDIAのIsaac Sim上で数百万回規模のシミュレーションを行った成果だとJSTの開発報告で説明されています。

重要なのは、AIRECが単なる力仕事の代替にとどまらない点です。夜間の体位変換や移乗介助といった、介護士の身体的・精神的負荷が最も高い業務を担うことで、人間は対話や感情ケアといった本質的なケアに集中できる環境が生まれています。この役割分担こそが、フィジカルAIが現場で受け入れられつつある最大の理由です。

| 活用領域 | フィジカルAIの役割 | 現場への効果 |

|---|---|---|

| 身体介助 | 体位変換・移乗・着替え補助 | 腰痛リスク低減と夜勤負荷の軽減 |

| 見守り | 行動検知・異常予兆の把握 | 事故防止と早期対応 |

| 医療支援 | 搬送・物品管理・遠隔操作補助 | 医療従事者の時間創出 |

医療分野でも同様の変化が起きています。AI搭載ロボットによる院内搬送や物品管理はすでに実運用に入り、医師や看護師が患者対応に使える時間を増やしています。世界経済フォーラムによれば、ロボット導入病院では看護業務の間接作業が2割以上削減された事例も報告されています。

さらに注目されるのが、IOWNや次世代通信を前提とした遠隔医療支援です。超低遅延ネットワークにより、地方病院に設置された手術支援ロボットを都市部の専門医が操作する実証が進んでいます。NTTの技術資料では、触覚フィードバックを含む操作遅延が人間の知覚限界以下に抑えられるとされ、医療の地域格差是正にも現実味が帯びています。

この分野で社会実装が進む最大の理由は、技術成熟だけではありません。日本ではロボットを「代替者」ではなく「共生者」と捉える文化的土壌があり、調査でも在宅介護ロボットを前向きに受け入れる層が過半数を占めています。フィジカルAIは、効率化の道具を超え、人間の尊厳を支えるインフラとして、介護・医療の現場に静かに根付き始めています。

サービス業とホスピタリティにおけるAIとロボット

サービス業とホスピタリティ分野では、2026年現在、AIとロボットが単なる省人化ツールではなく、顧客体験そのものを再設計する存在として定着しつつあります。特に日本では人手不足とインバウンド需要の同時進行により、接客の質を維持・向上させながら運営効率を高めることが急務となっています。

この課題に対し注目されているのが、生成AIを基盤としたAIコンシェルジュです。観光庁や業界レポートによれば、宿泊客の過去の行動履歴や嗜好データをAIが解析し、多言語でパーソナライズされた案内を行う仕組みが急速に普及しています。チェックイン前から滞在中、チェックアウト後まで一貫して体験を最適化する点が、従来のFAQ型チャットボットとの決定的な違いです。

例えば高級ホテルでは、AIが天候、混雑状況、個人の嗜好を統合し、その場で最適な観光ルートや飲食店を提案しています。世界経済フォーラムが指摘するように、こうしたハイパー・パーソナライゼーションは、顧客満足度だけでなくリピート率の向上にも直結します。

| 領域 | AI・ロボットの役割 | 現場への効果 |

|---|---|---|

| フロント業務 | 多言語AIコンシェルジュ | 待ち時間削減、24時間対応 |

| 館内運営 | 清掃・配膳ロボット | スタッフ負荷軽減、稼働率向上 |

| 収益管理 | 需要予測AI | 価格最適化、収益最大化 |

一方、物理的なロボットの役割も進化しています。配膳ロボットや清掃ロボットは裏方に留まらず、フロアやロビーで自然に稼働し、人間スタッフと協働しています。日本のサービスロボット市場は今後数年で大幅な成長が見込まれており、業界紙CIO Timesも「サービス品質を下げずに人手不足を補う現実解」と評価しています。

重要なのは、ロボットが人間を置き換えるのではなく、人間が本来担うべき感情的価値を引き出す余地を広げている点です。単純作業をAIとロボットに任せることで、スタッフは顧客との対話や細やかな気配りに集中できます。これは日本独自の「おもてなし」を、テクノロジーによって次の段階へ進化させているとも言えるでしょう。

サービス業とホスピタリティにおけるAIとロボットの本質は効率化ではなく、体験価値の持続的な向上にあります。この視点を持てるかどうかが、2026年以降の競争力を左右しています。

6GとIOWNが支えるリアルタイム制御の未来

フィジカルAIが現実世界で安全かつ高度に機能するためには、知能そのものだけでなく、それをつなぐ通信インフラが決定的な役割を果たします。2026年現在、その中核にあるのが6GとNTTが主導するIOWNです。**これらはロボットや自律システムの「神経系」として、リアルタイム制御の質を根本から引き上げています。**

従来の5Gでは、ミリ秒単位の遅延が不可避であり、遠隔操作や複数ロボットの協調制御には限界がありました。6Gでは、要件定義の段階から1ミリ秒未満、場合によってはマイクロ秒単位の超低遅延が想定されています。世界経済フォーラムや日本のBeyond 5G戦略でも、**遠隔手術、分散工場制御、自律移動体の群制御**が主要ユースケースとして明示されています。

| 指標 | 5G | 6G(想定) |

|---|---|---|

| 遅延 | 1〜10ms | 1ms未満 |

| 最大速度 | 10Gbps | 1Tbps |

| 測位精度 | cm級 | mm級 |

特に注目されているのが、通信とセンシングを一体化するISACという考え方です。これは電波の反射や変化をAIが解析し、カメラやLiDARが届かない死角でも人や物体の位置を把握する技術です。**工場や街中で人とロボットが共存する環境において、安全性を飛躍的に高める鍵**になると評価されています。

一方、IOWNは「光」を軸にした日本発のアプローチです。オールフォトニクス・ネットワークにより、電気変換による待ち時間を極限まで削減し、消費電力も大幅に抑えます。NTTデータやIOWN Global Forumの事例では、**遠隔地のロボット操作で触覚フィードバックの違和感がほぼ消失した**と報告されています。

この特性は、デジタルツインとの完全同期にも直結します。物理空間のロボットの状態が即座に仮想空間へ反映され、AIが未来予測を行い、その結果を再び現実へ返す。この往復が遅延なく成立することで、**リアルタイム制御は「反応」から「予測」へと進化**します。

6GとIOWNがもたらすのは、通信速度の向上ではありません。人間の神経反射に近いレベルでAIと機械を結び、離れた場所の行動を一体化させることです。**フィジカルAIが社会インフラとして溶け込むための前提条件が、いま現実になりつつあります。**

人間とAIの信頼関係と倫理、労働の再定義

フィジカルAIが社会に深く入り込む2026年において、人間とAIの関係性は単なる「使う・使われる」を超え、信頼と倫理を基盤とした協働関係へと進化しています。特に身体を持つロボットは、判断や行動の結果が人間の安全や尊厳に直結するため、技術性能以上に社会的受容と倫理設計が重要になります。

世界経済フォーラムによれば、物理空間で動作するAIに対する信頼は「予測可能性」「説明可能性」「責任の明確化」の3点に左右されるとされています。日本ではこれを背景に、AI推進法と連動したガイドライン運用が進み、AIがなぜその判断を行ったのかを人間が理解できる説明可能なAIの研究が加速しています。

| 信頼構成要素 | 内容 | 社会的効果 |

|---|---|---|

| 予測可能性 | 挙動が一貫し再現性がある | 不安や恐怖の低減 |

| 説明可能性 | 判断理由を言語化できる | 責任所在の明確化 |

| 透明性 | 設計思想や制約の開示 | 社会的受容の向上 |

倫理面で注目すべきは、日本独自の「人間中心のAI」という考え方です。内閣府や関係省庁が示す指針では、人権尊重やプライバシー保護だけでなく、人間の判断を最終決定として残す設計が重視されています。これは完全自律を目指すのではなく、人とAIが役割を分担する前提に立ったアプローチです。

実際、介護や医療現場では、ロボットが身体的負荷の高い作業を担い、人間は感情的ケアや倫理判断に集中するモデルが定着しつつあります。高齢者を対象とした国内調査では、ロボットへの信頼感は「人間の監督がある場合」に大きく高まることが示されており、完全無人化よりも協働設計が受け入れられやすいと報告されています。

この流れは労働の再定義にも直結します。国際通貨基金が以前から指摘してきたように、自動化は雇用を奪うのではなく、仕事の中身を変える力を持っています。2026年の日本では、ロボットを管理・教育・監督する役割が新たな職能として広がり、AIリテラシーは専門職だけでなく一般労働者にも必須の基礎スキルとなりました。

さらに議論が進んでいるのが、自動化の果実を社会全体でどう分配するかという倫理的課題です。ロボット税や再教育投資といった制度設計はまだ過渡期ですが、労働時間短縮や高齢者支援への再分配を通じて、AIが生み出す価値を人間の幸福に結びつけようとする動きが現実味を帯びています。

人間とAIの信頼関係とは、万能な知能を盲信することではありません。限界やリスクを理解した上で役割を委ね、必要な場面では人が介入できる余地を残すことです。倫理とは技術のブレーキではなく、社会に根付かせるための土台であり、その設計力こそがAI時代の競争力になりつつあります。

参考文献

- The Japan Times:Japan’s long return to artificial intelligence

- International Federation of Robotics:Top 5 Global Robotics Trends 2026

- Figure AI:F.02 Contributed to the Production of 30,000 Cars at BMW

- TechSci Research:Japan Artificial Intelligence Market Size & Forecast | 2030F

- arXiv:Pure Vision Language Action (VLA) Models: A Comprehensive Survey

- NTT Group:IOWN Application Examples