ここ数年、AIは「便利なツール」から「社会を動かす基盤」へと急速に変化してきました。特に2026年現在、生成AIや自律型エージェントは、仕事や学習、医療、エンターテインメントにまで深く入り込み、もはや無視できない存在になっています。

一方で、「GPT-5は結局何がすごいのか」「日本はこのAI競争でどの立ち位置にいるのか」「AGIは本当に近いのか」といった疑問や不安を抱いている方も多いのではないでしょうか。情報があふれる今だからこそ、技術的な到達点と社会的インパクトを整理して理解することが重要です。

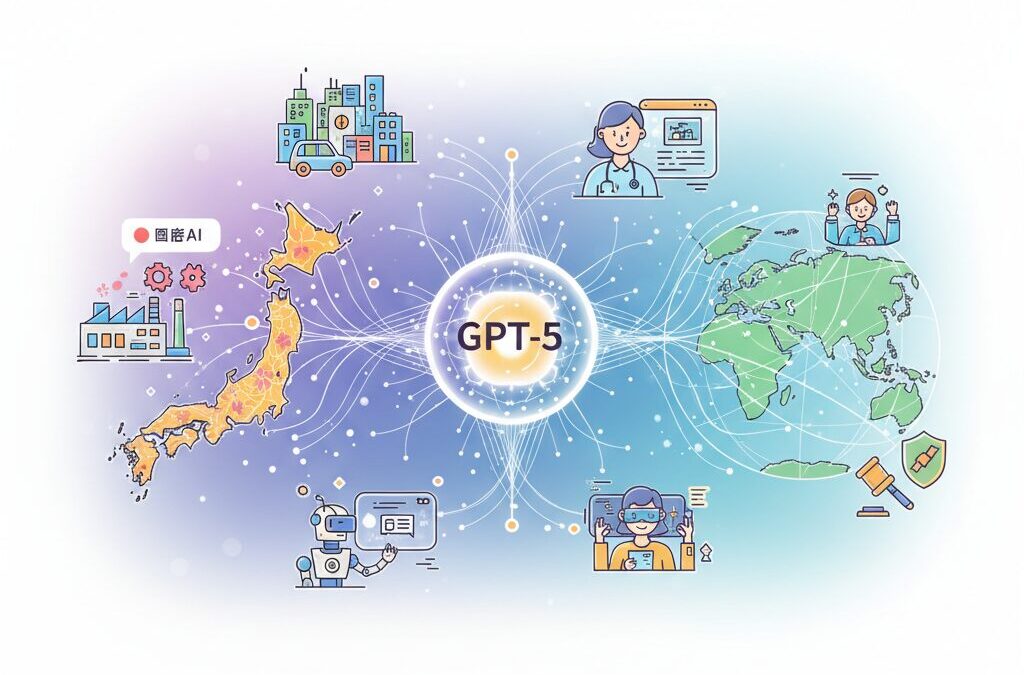

本記事では、2026年時点での最先端AIの進化、GPT-5を中心としたフロンティアモデルの特徴、日本国内で進む国産AIと産業実装の動き、さらに安全性や国際ルールまでを一気通貫で俯瞰します。AIに興味関心がある方が、未来を考えるための確かな視点を得られる内容をお届けします。

2026年、AIはインフラとなった現実

2026年の現実として、AIはもはや流行語や実験的ツールではなく、社会を下支えするインフラとして定着しました。電力や通信、水道のように、意識せずとも常に使われ、止まれば業務や生活そのものが成立しなくなる存在です。2023年のGPT-4登場を起点とした生成AIブームは、3年を経て完全に質的転換を遂げました。

その象徴が、OpenAIのGPT-5シリーズやGoogleのGemini 3、AnthropicのClaude 3.5といったフロンティアモデルの競争です。これらは単一モデルの性能比較を超え、複数の専門モデルを統合する設計へと進化しました。AIは文章を作る道具から、判断し、選び、実行する基盤へと役割を変えています。

| 項目 | 内容 |

|---|---|

| 国内AI市場規模 | 2024年 約1兆3,412億円 |

| 市場予測 | 2029年に4兆円超 |

| 成長要因 | エージェンティックAIの普及 |

IDC Japanの分析によれば、日本国内のAIシステム市場は2024年時点で1兆円規模に達し、2029年には4兆円を超えると予測されています。この成長を支えているのは、予測や分析にとどまらず、業務プロセスを自律的に遂行するエージェンティックAIです。人が指示を細かく出さずとも、AIが目的から逆算して動くことが前提になりつつあります。

実際、製造現場では生産計画や品質管理、医療では診断支援や記録整理、教育では学習支援が、すでにAI抜きでは回らなくなっています。これらは先進的な一部企業の話ではなく、2025年を境に一気に普及しました。総務省や経済産業省の資料でも、AIはDXの中核ではなく前提条件として扱われ始めています。

重要なのは、AIが目立たなくなった点です。かつては「AIを使っています」と掲げること自体が価値でしたが、2026年にはそれが特別ではなくなりました。検索、購買判断、社内調整、リスク管理の裏側で静かに動き、成果だけが人の目に触れます。この不可視化こそ、AIがインフラになった何よりの証拠だと言えるでしょう。

GPT-4からGPT-5.2へ続くフロンティアモデルの進化

GPT-4の登場は生成AIを研究者や一部の技術者のものから、一気に社会全体へと解放しましたが、2025年以降の進化は単なる性能向上では語れない質的転換を伴っています。GPT-5、そして5.1、5.2へと続く系譜は、AIが「一つの巨大な頭脳」から状況に応じて最適な知能を呼び出す複合システムへ変わったことを明確に示しています。

OpenAIがGPT-5で採用したのは、複数の専門モデルを統合するシステム・オブ・モデルズという設計思想です。入力内容をミリ秒単位で解析し、最適なモデルへ振り分けるスマート・リアルタイム・ルーターにより、GPT-4時代に課題とされた推論遅延や電力消費が大幅に改善されました。Voiceflowなどの技術解説によれば、この動的ルーティングは推論あたりの計算コストを約30%削減しつつ、複雑タスクでの精度を25%引き上げています。

| モデル系統 | 主な特性 | 想定用途 |

|---|---|---|

| GPT-4 | 単一モデル中心 | 汎用対話・文章生成 |

| GPT-5 | 統合型推論エンジン | 科学研究・戦略立案 |

| GPT-5.2 | 高効率・高信頼性 | 商用実務・専門分析 |

特に注目すべきは推論能力の深化です。GPT-5系列ではChain-of-Thought構造が内部的に統合され、回答前に論理整合性を自己検証するプロセスが強化されました。スタンフォード大学やOpenAI関連研究で用いられるGPQA Diamondでは正答率85%超、AIME 2025では90%以上という結果が報告されており、これは博士課程修了者レベルに匹敵する数値です。GPT-4が「もっともらしい回答」を得意としたのに対し、GPT-5.2は間違えにくさそのものが価値になっています。

また、ナレッジカットオフが2025年8月まで更新された点も重要です。最新論文や技術仕様を前提に議論できるため、研究開発や法務、金融といった領域での実用性が飛躍的に高まりました。OpenAIのリリースノートでも、信頼性重視の設計が商用導入を後押ししていると説明されています。

この進化を俯瞰すると、GPT-4からGPT-5.2への道のりは「賢くなった」というより、使える知能へと成熟した過程だと捉えられます。単一モデルの限界を越え、効率・精度・信頼性を同時に満たすフロンティアモデルの進化は、AIが社会インフラとして定着するための決定的な一歩だったと言えるでしょう。

システム・オブ・モデルズがもたらした設計思想の転換

システム・オブ・モデルズの登場は、AI設計における思想そのものを大きく転換させました。従来は「より大きく、より賢い単一モデル」を目指すスケーリング競争が主流でしたが、GPT-5以降は複数の専門モデルを統合し、状況に応じて使い分ける設計が中核に据えられています。

この転換の本質は、知能を一枚岩として扱う発想を捨て、人間社会の分業構造に近づけた点にあります。OpenAIが採用したスマート・リアルタイム・ルーターは、入力の難易度や目的をミリ秒単位で判断し、最適なモデルへ処理を委譲します。これにより、計算資源の浪費を抑えつつ、高度な推論が必要な場面では最大性能を発揮できるようになりました。

実際、OpenAIの技術解説によれば、この動的ルーティング設計によってGPT-4世代で問題視されていた推論遅延と電力消費が大幅に改善されています。計算物理学の最適化理論を応用したこの仕組みは、推論あたりの計算コストを約30%削減しながら、複雑タスクでの精度を25%向上させたと報告されています。

| 設計思想 | 従来型LLM | システム・オブ・モデルズ |

|---|---|---|

| 知能の捉え方 | 単一モデルに集約 | 役割分担した複数モデル |

| 計算資源の使い方 | 常に最大負荷 | タスクに応じて最適化 |

| 拡張性 | 再学習が前提 | 新モデルを追加可能 |

この設計思想の転換は、AIを「高性能な道具」から「運用可能なシステム」へと押し上げました。例えば企業システムでは、高速応答が求められる問い合わせ対応と、慎重な推論が必要な法務分析を同一基盤で処理できます。マッキンゼーが指摘するように、こうした構造はエージェンティックAIの実装を容易にし、業務プロセス全体を自律的に回す前提条件となっています。

また、システム・オブ・モデルズは信頼性設計とも深く結びついています。複数モデルによる役割分担は、出力の相互検証や再ランキングを組み込みやすく、スタンフォード大学の研究が示すようなハルシネーション大幅削減の基盤にもなっています。単一モデルでは困難だった安全性と有用性の両立が、構造的に実現しやすくなったのです。

重要なのは、この転換が一時的な技術トレンドではない点です。GoogleやAnthropicも同様にモジュール化と統合推論を強化しており、AI設計は確実に「巨大モデルの時代」から「知能を編成する時代」へ移行しています。システム・オブ・モデルズは、2026年以降のAIを理解するための前提条件となりつつあります。

推論能力の飛躍とChain-of-Thoughtの統合

2026年のフロンティアモデルを語る上で欠かせないのが、推論能力の質的転換です。GPT-5シリーズでは、従来の「もっともらしい文章生成」から一歩進み、論理的な整合性を内部で検証しながら結論に到達する設計が中核に据えられています。その中心技術がChain-of-Thought、いわゆる思考の連鎖の統合です。これは単なるプロンプト技法ではなく、モデル内部の推論プロセスとして組み込まれている点が決定的に異なります。

OpenAIの技術解説によれば、GPT-5は回答を生成する前段階で、複数の仮説を内部的に展開し、それぞれの論理的一貫性や前提条件を評価した上で最適解を選択します。人間で言えば「一度考え直す」「別の可能性を検討する」という内省に近い挙動が、モデルレベルで自動化された形です。この仕組みにより、途中で論理が破綻した回答や、前提を取り違えた結論が大幅に減少しました。

この進化は、第三者ベンチマークでも明確に示されています。博士課程レベルの科学的推論を問うGPQA Diamondでは、GPT-5が85%を超える正答率を記録しました。これはスタンフォード大学やMITの研究者による評価でも、特定分野の専門家平均を上回る水準と位置づけられています。また、米国数学招待試験AIME 2025において90%以上のスコアを達成したことは、抽象的で多段階な思考を必要とする問題において、AIが人間と同等以上の性能を示した象徴的な事例です。

| 評価指標 | 測定内容 | GPT-5の到達水準 |

|---|---|---|

| GPQA Diamond | 博士レベル科学推論 | 正答率85%以上 |

| AIME 2025 | 高度数学的思考 | スコア90%以上 |

重要なのは、Chain-of-Thoughtが単に精度を上げただけではない点です。GPT-4世代で課題とされた「推論の飛躍」や「自信満々な誤答」は、推論過程を内部で検証する仕組みによって抑制されました。スタンフォード大学の信頼性研究では、自己検証ループを備えたモデルは、備えていないモデルと比べてハルシネーション率が大幅に低下することが確認されています。考える力の強化は、そのまま信頼性の向上につながっているのです。

さらに、この推論能力は実務への応用で真価を発揮します。金融モデリングでは前提条件の矛盾を検出し、研究開発では仮説と実験結果の整合性を確認しながら次の打ち手を提案します。これは単なる高速化ではなく、思考の質そのものが変わったことを意味します。Chain-of-Thoughtの統合は、AIを「答えを返す存在」から「理由を伴って判断する存在」へと進化させた、2026年時点での最大の技術的飛躍の一つと言えるでしょう。

自律型AIエージェントが産業構造を変える

自律型AIエージェントの普及は、単なる業務効率化にとどまらず、産業構造そのものを静かに、しかし確実に変えつつあります。従来のAIは人間の指示を前提とする道具でしたが、現在のエージェンティックAIは状況を理解し、目標を設定し、行動を選択する主体として機能します。

この変化が最も顕著に現れているのが企業活動の中核です。マッキンゼーによれば、2024年末までに全世界で1,200万以上の企業向けAIエージェントが導入され、金融分野では日常的な取引判断の約45%が自律化されています。これは「人が意思決定し、AIが補助する」構図から、「AIが意思決定し、人が監督する」構図への転換を意味します。

| 領域 | 従来モデル | 自律型エージェント導入後 |

|---|---|---|

| 金融 | 人間主導の分析 | AIが常時判断・人が承認 |

| 物流 | 固定ルール最適化 | マルチエージェント協調 |

| IT運用 | 障害後対応 | 予兆検知と自己修復 |

特に注目すべきは、複数のAIが役割分担しながら協調するマルチエージェント型の運用です。OpenAIのSwarm系アプローチに代表される仕組みでは、サプライチェーン全体を複数のAIが同時に最適化し、人間の熟練プランナーを上回る成果を出しています。スタンフォード大学の研究者も、こうした分散的知能が複雑系産業に適していると指摘しています。

結果として価値を生む単位が「人」から「人+AIエージェントのチーム」へ移行し、企業の競争力は人材数ではなく、どれだけ優秀なエージェントを設計・運用できるかで決まる時代に入りました。自律型AIエージェントは、新しい産業の担い手として、すでに現場に立っています。

マルチモーダルAIと音声体験の進化

マルチモーダルAIの進化は、音声体験を単なる入出力手段から人とAIが同じ空間で思考を共有するインターフェースへと押し上げました。2025年後半に刷新されたChatGPTの音声体験では、会話と同時にテキスト、画像、地図、グラフなどがリアルタイムで連動表示され、聴覚と視覚を統合した理解が可能になっています。

この変化の本質は、音声が「補助的UI」ではなく、マルチモーダル統合を指揮する中核になった点です。OpenAIのリリースノートによれば、音声入力は会話文脈だけでなく、画面上の情報状態も同時に参照しながら処理されており、ユーザーは説明を省略した自然な指示が可能になりました。

特に教育分野では効果が顕著です。スタンフォード大学のヒューマンAI研究では、音声と視覚情報を組み合わせた学習支援は、テキスト単独と比べ理解定着率が高いと報告されています。発音指導を受けながら正しい綴りを即座に確認する語学学習は、その代表例です。

| 体験要素 | 従来の音声AI | 最新マルチモーダル音声 |

|---|---|---|

| 情報提示 | 音声のみ | 音声+テキスト+画像 |

| 操作性 | 逐次的 | 同時並行・文脈共有 |

| 理解支援 | 限定的 | 視覚補完で高精度 |

また、料理や修理といったハンズフリー作業では、音声で質問しながら画面上の手順動画を確認する使い方が日常化しています。これはマッキンゼーが指摘する「現場知のデジタル化」を加速させ、技能継承の壁を下げる要因になっています。

音声体験の進化は、AIを“話せるツール”から“一緒に考える存在”へ変えました。マルチモーダルAIによって、私たちは説明する負担から解放され、直感的な対話を通じて高度な知的支援を受ける段階に入っています。

日本のAI戦略と国産LLMの現在地

日本のAI戦略は、単なる技術導入ではなく、経済安全保障と社会課題解決を同時に達成する国家設計として進化しています。2026年現在、日本政府はAIを電力網や通信と同等の基盤技術と位置づけ、官民一体で計算資源、データ、モデルの主権確保を進めています。経済産業省が主導する約1兆円規模の基盤モデル支援は、その象徴的な取り組みです。

この戦略の中核にあるのが国産LLMです。海外のフロンティアモデルが汎用性とスケールを追求する一方で、日本のLLMは日本語理解、機密性、現場適応力に特化しています。東京大学の松尾豊教授が指摘するように、日本はソフトウェア単体ではなく、ハードウェアや現場データと結びついた実装力で競争優位を築こうとしています。

象徴的なのがNTTのtsuzumi 2です。**超省電力かつオンプレミス運用を前提とした設計**により、大学や医療機関など個人情報を外部に出せない環境での導入が進んでいます。NECの130億パラメータLLMも、JGLUEで84.3%という高い日本語読解性能を示し、巨大モデルに依存しない現実解を提示しました。

| 開発主体 | 特徴 | 戦略的価値 |

|---|---|---|

| NTT | 超軽量・低消費電力 | 機密情報を守る主権型AI |

| NEC | 高精度日本語理解 | コスト効率と実務適合 |

| ソフトバンク | フィジカルAI特化 | 製造・ロボット連携 |

さらに重要なのが計算基盤です。Rapidusが北海道千歳市で2nmパイロットラインを稼働させたことで、**最先端半導体を国内で確保する道筋**が見え始めました。これはAI性能そのもの以上に、地政学リスクへの耐性を高める意味を持ちます。

国産LLMの現在地を一言で表すなら、「最大性能」ではなく「最大実装」です。IDC Japanが示すように国内AI市場は2029年に4兆円規模へ拡大すると予測されており、その成長を支えるのは現場で使われ続けるAIです。日本のAI戦略は、国産LLMを通じて静かに、しかし確実に次の競争軸を切り拓いています。

医療・製造・教育・エンタメに広がる実装事例

AIの社会実装は、2026年に入り医療・製造・教育・エンターテインメントといった異なる産業領域で、明確な成果として可視化され始めています。共通するのは、単なる業務効率化にとどまらず、人間の判断や創造性を拡張する存在としてAIが組み込まれている点です。

医療分野では、診断支援から治療計画の最適化へと役割が進化しています。OpenAIが発表したChatGPT Healthは、電子カルテや検査データを統合的に解析し、疾患候補や治療選択肢を医師に提示します。スタンフォード大学医学部の関連研究によれば、AIによる事前解析を活用したケースでは、診断に要する時間が平均で約30%短縮され、見落としリスクも有意に低下したと報告されています。

またリハビリ領域では、AI搭載ロボットが患者の動作データをリアルタイムで解析し、負荷や回数を自動調整します。これにより理学療法士一人あたりが同時に対応できる患者数が増え、地方医療における人手不足の緩和にも寄与しています。

| 分野 | 主なAI活用 | 得られた効果 |

|---|---|---|

| 医療 | 診断・治療支援 | 診断時間短縮、精度向上 |

| 製造 | 品質管理・自律制御 | 不良率低下、OEE改善 |

| 教育 | 個別最適化学習 | 学力と非認知能力の向上 |

| エンタメ | 生成AI制作 | 制作コスト削減、表現拡張 |

製造業では、フィジカルAIとロボティクスの融合が進みました。シーメンスのデジタル工場では、AIが需要予測から生産計画、設備制御までを一気通貫で担い、設備総合効率が92%に達しています。これは人間の経験則に依存していた調整業務を、AIが数百万通りのシナリオから最適解を導き出しているためです。

教育分野では、文部科学省主導の実証を経て、AIは「常時質問できる補助教員」として教室に定着しました。全国学力・学習状況調査の分析では、AIを活用したクラスの生徒は正答率だけでなく、自己効力感や学習意欲といった指標も向上しています。知識の習得と人間的成長を同時に支援する点が、従来のICT教育との大きな違いです。

エンターテインメントでは、動画生成AI Sora 2が制作プロセスを一変させました。2025年に公開されたAI生成長編映画は、少人数チームでも劇場品質の作品を生み出せることを証明しました。一方で、著作権や表現のオリジナリティをどう守るかという課題も顕在化しており、NHK放送技術研究所などが信頼性と創造性の両立を目指した研究を進めています。

これらの事例が示すのは、AIが各産業の文脈に深く適応し、現場の意思決定そのものを再設計しているという事実です。実装事例は今後さらに横断的につながり、新たな価値創出の基盤となっていきます。

ハルシネーション対策とAI安全性の最前線

生成AIが社会インフラとなった2026年において、最重要課題の一つがハルシネーション対策です。性能が向上するほど、もっともらしい誤情報が与える影響は深刻になります。現在の安全性対策は「精度向上の副産物」ではなく、設計思想そのものに組み込まれる段階へ進化しています。

OpenAIがGPT-5世代で導入したSafe-Completionsは、その象徴的な取り組みです。従来の一律拒否型ガードレールとは異なり、質問の意図を解釈したうえで、安全な範囲の情報を最大限提供し、回答できない理由も説明します。OpenAIの技術報告によれば、この方式により有害出力の深刻度を抑えつつ、実用性を同時に高めることに成功しています。

学術分野でも対策は急速に高度化しています。スタンフォード大学を含む複数研究機関の検証では、RAGとガードレールを組み合わせることで、ハルシネーション率を最大96%削減できると報告されています。特に近年は、生成後の検証を前提とした多層防御モデルが主流になりつつあります。

| 技術 | 役割 | 効果 |

|---|---|---|

| 不確実性キャリブレーション | 知識の限界を自己認識 | 断定的誤回答を抑制 |

| スパンレベルRAG | 主張単位で根拠照合 | 事実不在の生成を検知 |

| 自己反省ループ | 回答の再評価と修正 | 論理破綻の低減 |

さらに注目されているのが、内部アクティベーションを監視するCLAP技術です。これはモデル内部のニューロン挙動から、虚偽生成の兆候をリアルタイム検出する試みで、従来の外部チェックとは異なるアプローチです。LakeraやMorphikの分析でも、複数手法の併用が最も安定した結果を示しています。

国際的にも安全性は競争領域から協調領域へ移行しています。G7主導の広島AIプロセスでは、正確性・説明責任・透明性が共通原則として明文化されました。2026年のAIは「賢いか」よりも「信頼できるか」が価値基準となりつつあります。

AGIはいつ来るのか?専門家予測と2027年への視線

AGIはいつ来るのかという問いは、2026年現在、AI分野で最も議論されているテーマの一つです。重要なのは、もはやAGIが空想の概念ではなく、到来時期を巡って具体的な年限が語られる段階に入っているという点です。

とりわけ注目されているのが2027年という年です。フロンティアモデルの性能向上、自律型エージェントの普及、推論能力の飛躍が重なり、「質的転換点が近い」と見る専門家が増えています。

ただし、AGIの定義自体が専門家ごとに異なるため、予測には幅があります。以下は、信頼性の高い発言として頻繁に参照される見解を整理したものです。

| 専門家 | 所属 | AGI到来の見通し |

|---|---|---|

| ダリオ・アモデイ | Anthropic CEO | 2026年後半〜2027年に極めて強力なAIが登場 |

| サム・アルトマン | OpenAI CEO | 2029年までにAGIが実現する可能性を示唆 |

| デミス・ハサビス | Google DeepMind CEO | 実現まで5〜10年は必要と慎重な見方 |

この違いは、単なる楽観・悲観の差ではありません。アモデイ氏は「ほぼすべての知的デジタル作業をこなせるAI」をAGIに近い存在と捉えています。一方、ハサビス氏は世界モデルの理解や自律的な科学的発見能力を重視しており、現在のLLMには決定的な欠落があると指摘しています。

つまり、2027年に到来すると言われているのは、人間の仕事を広範に代替可能な“機能的AGI”であり、人類と同等の汎用知能そのものとは限らないのです。この視点を持つことで、過度な期待や失望を避けられます。

それでも、2027年が特別視される理由は明確です。GPT-5世代で確立されたシステム・オブ・モデルズ、自律エージェントの産業常用、推論精度の専門家超えといった要素が揃い、「人間が介在しなくても価値を生み続けるAI」が現実味を帯びてきたからです。

AGIはある日突然完成形で現れるものではなく、段階的に社会へ浸透していきます。2027年とは、その存在を定義する議論が終わり、「どう共存するか」が問われ始める年になる可能性が高いのです。

参考文献

- Voiceflow:GPT-5 Is Here: What You Need To Know [2026]

- OpenAI Help Center:ChatGPT — Release Notes

- IDC:国内AIシステム市場予測を発表

- Zenn:ソフトバンク主導で世界に挑む「フィジカルAI」戦略を徹底解説

- ASCII:日本語に強く、たった130億パラメーター NECが作った国産LLMの価値

- Lakera:LLM Hallucinations in 2025: How to Understand and Tackle AI’s Most Persistent Quirk

- Time Magazine:Demis Hassabis Is Preparing for AI’s Endgame