ここ数年でAIは驚異的なスピードで進化し、私たちの仕事や生活に深く入り込む存在になりました。文章生成や画像作成に驚いていた時代は過ぎ、いま注目されているのは、AIが自ら目標を理解し、計画を立て、行動まで実行する「エージェンティックAI」です。

2026年現在、AIはもはや便利なツールではなく、意思決定や業務そのものを担う“自律的なパートナー”へと変貌しています。世界のAI投資額は急拡大を続け、日本でも国産LLMや産業特化型AIが実務の現場で本格稼働し始めました。

本記事では、GPT-5やGemini、Claudeといった最先端モデルの技術的到達点から、日本企業の取り組み、医療・製造・教育など各産業へのインパクト、さらにはAIガバナンスやAGIの未来像までを俯瞰します。AIに興味がある方が「いま何が起きているのか」「これから何を意識すべきか」を整理できる内容ですので、ぜひ最後までご覧ください。

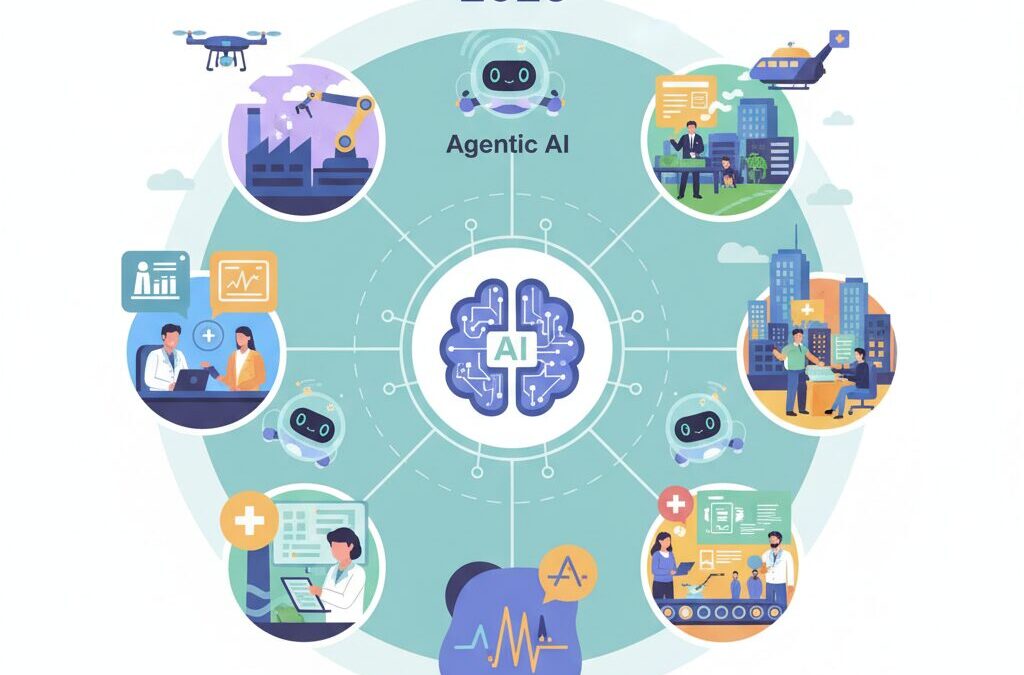

人工知能は新しい段階へ:エージェンティックAIとは何か

2023年以降に急速に普及した大規模言語モデルは、文章生成や要約といった「受動的な知能」として理解されてきました。しかし2026年現在、人工知能は明確な目的を持ち、自ら計画し、行動し、結果を検証するエージェンティックAIという新しい段階に入っています。これは人間が逐一指示を与えるプロンプト型AIから、AI自身が目標を解釈し、複雑な業務を自律遂行する存在への転換を意味します。

エージェンティックAIの本質は「意思決定と実行の一体化」にあります。従来のAIは提案までが役割でしたが、エージェンティックAIは外部ツールやシステムと連携し、実際にタスクを完了させます。Gartnerによれば、2026年の世界AI支出は約2.5兆ドルに達し、その多くが業務プロセスに組み込まれる自律型AIに向けられています。この投資の急増は、AIが単なる分析支援ではなく、企業活動の実行主体として期待されている証左です。

| 観点 | 従来型AI | エージェンティックAI |

|---|---|---|

| 役割 | 情報生成・提案 | 計画立案から実行まで |

| 操作方法 | 人間の逐次指示 | 目標ベースの自律行動 |

| 価値 | 効率化 | 業務そのものの代替・再設計 |

技術的背景として重要なのが、推論時に計算資源を動的に配分する「テストタイム計算量」の進化です。OpenAIやGoogleの最新モデルでは、即答せず内部で思考と検証を重ねる設計が標準化しつつあります。OpenAIが公表した実務タスク指標では、最新モデルが人間の専門職と同等、あるいはそれ以上の成果を示しました。これにより、AIが長い業務フローを一貫して扱える土台が整っています。

エージェンティックAIはデジタル空間に留まりません。日本では労働力不足を背景に、業務システムやロボティクスと結合した活用が進んでいます。例えば、社内システムを横断して処理を行うAIエージェントは、申請、確認、支払いといった一連の作業を人手なしで完結させます。これは単なる自動化ではなく、業務設計そのものをAI前提で再構築する動きです。

重要なのは、エージェンティックAIが「万能の知能」ではない点です。自律性が高まるほど、権限設計や検証プロセスが不可欠になります。Gartnerは、AIが自律行動を取る時代において、ガードレールと監視体制を組み込んだ運用が競争力を左右すると指摘しています。つまり、エージェンティックAIとは技術トレンドであると同時に、組織の意思決定の在り方そのものを問い直す存在なのです。

次世代フロンティアモデルの競争:GPT-5・Gemini・Claudeの現在地

次世代フロンティアモデルの競争は、単なる性能比較の段階をすでに超えています。GPT-5、Gemini、Claudeはいずれも「賢く答えるAI」ではなく、自律的に考え、判断し、行動する知能を前提に設計されている点が共通しています。その一方で、各社の思想や強みは明確に分かれ始めています。

OpenAIのGPT-5系列は、「思考」を内部プロセスとして明示的に組み込んだ点が最大の特徴です。2025年末に公開されたGPT-5.2では、出力前に推論トークンを生成し、自己検証を行うアーキテクチャが採用されました。OpenAIの公式発表によれば、知的労働タスクを想定したGDP-Valで70%を超える勝率を記録しており、これはAIが専門職レベルの意思決定を代替し得る段階に入ったことを示唆しています。

一方、GoogleのGeminiは「モデル単体の賢さ」よりもプラットフォーム全体への統合力に軸足を置いています。Gemini 3は100万トークン超の長大な文脈を安定して扱える設計となっており、検索、Workspace、Androidといった既存サービスに深く組み込まれました。Google自身が強調するのは、AIが人間の作業フローを分断する存在ではなく、日常業務の背後で一貫性を保つ基盤になるという位置付けです。

AnthropicのClaudeは、持続的な推論と安全性を最重要視するアプローチを取り続けています。直近のClaude Opus 4.5は、OSWorldという自律的なPC操作ベンチマークで高いスコアを記録しました。これは、Claudeが単発の質問応答ではなく、画面操作やツール利用を含む複雑なタスクを、人間に近い形で遂行できることを示しています。専門家の間では、Claude 5でこの「長時間・長文脈の思考」がさらに洗練されると見られています。

| モデル | 設計思想の中核 | 際立つ強み |

|---|---|---|

| GPT-5 | 思考プロセスの内部化 | 高難度推論と実務適用力 |

| Gemini 3 | プラットフォーム統合 | 超長文脈と業務一貫性 |

| Claude | 持続的推論と安全性 | 自律操作と信頼性 |

この比較から見えてくるのは、「どのモデルが最強か」という単純な問いが意味を失いつつあるという現実です。スタンフォード大学やGartnerの分析でも指摘されているように、2026年のフロンティアモデル競争は用途や環境に応じて知能を選び、組み合わせる時代に突入しています。

GPT-5は高度な判断を任せたい中核エージェントとして、Geminiは既存業務に溶け込む基盤として、Claudeは安全性と長期タスクを担う調整役として機能します。次世代モデルの競争とは、性能の優劣ではなく、どの知能がどの役割を担うのかという「知能の分業設計」を巡る競争だと言えるでしょう。

推論力はどこまで高まったのか:最新ベンチマークが示す実力

近年のAI進化を語る上で、推論力がどこまで高まったのかを客観的に示す指標として、最新ベンチマークの結果は欠かせません。2025年後半から2026年初頭にかけて登場したフロンティアモデルは、従来の「それらしい文章を出すAI」から「筋道立てて考え、検証するAI」へと明確に段階を上げています。特に注目されているのが、テスト時に追加計算を行うテストタイム計算量を活用した推論アーキテクチャです。

OpenAIが公開したGPT-5.2 Thinkingは、その象徴的な存在です。OpenAIの公式発表によれば、内部で推論トークンを生成し、自己検証を挟む設計により、数学や科学だけでなく、実務に近いタスクでも大幅な性能向上が確認されています。これは単なる学術的スコアの改善ではなく、AIの思考プロセスそのものが変化したことを示しています。

| ベンチマーク | 評価対象 | GPT-5.2 Thinking |

|---|---|---|

| GDP-Val | 知的労働タスク勝率 | 70.9% |

| AIME 2025 | 数学オリンピック級問題 | 100.0% |

| ARC-AGI-2 | 抽象的推論能力 | 52.9% |

中でもGDP-Valは、実際のビジネス課題を想定した評価指標であり、70.9%という数値はAIが人間の専門職と競合しうる水準に達したことを意味します。Gartnerなどの調査機関が「AIは意思決定の主体に近づいている」と指摘する背景には、こうした実務寄りベンチマークの存在があります。

また、GoogleのGemini 3やAnthropicのClaude Opus 4.5も、長い文脈を保持したまま多段階の推論を維持する能力で高評価を得ています。特に10ステップ以上の論理的一貫性を測る評価では、人間が途中で見落としがちな前提条件を保持し続ける点が専門家から評価されています。スタンフォード大学をはじめとする研究コミュニティでも、こうした「持続的推論」が次世代AIの核心だと位置づけられています。

重要なのは、ベンチマークの数字そのもの以上に、AIが「考え直す」「間違いを検出する」能力を内包し始めた点です。抽象推論を測るARC-AGI-2での大幅な改善は、未知の問題に対しても構造を見抜く力が育ちつつある証拠といえます。推論力の進化は、AIを単なる補助ツールから、信頼して仕事を任せられる存在へと押し上げる決定打になりつつあります。

日本のAI戦略:国産LLMとソブリンAIの台頭

日本のAI戦略は、単なる技術競争ではなく、データ主権と経済安全保障を軸にしたソブリンAIの確立へと明確に舵を切っています。これまで日本企業は、海外製LLMの日本語対応や業務適用に注力してきましたが、2026年に入り、国産LLMを中核とする独自エコシステムが実務レベルで稼働し始めています。

この動きを象徴するのが、NTT、NEC、ソフトバンクの三社です。NTTのtsuzumi 2は、70億パラメータという軽量設計ながら、日本語MT-Benchで世界最先端モデルと同等の評価を獲得しています。背景には、次世代通信基盤IOWNとの融合があります。光電融合デバイスによる超高速・低消費電力通信により、**巨大モデルを一極集中で動かすのではなく、複数の軽量AIが協調する分散知能**という日本独自のアプローチが現実化しています。

一方、NECはcotomiを産業特化型AIとして進化させています。医療、金融、自治体といった高い正確性と説明責任が求められる領域に絞り、推論速度と信頼性を最優先する戦略です。Gartnerが指摘するように、2026年はAI投資のROIが厳しく問われる年であり、cotomiが評価されている理由も、派手な生成能力ではなく、**業務自己解決率の向上や問い合わせ削減といった定量成果**にあります。

ソフトバンクは対照的に、圧倒的な計算規模で主権型AIを構築しています。1.6兆パラメータ級とされるSarashina系モデルは、国内最大級のGPU基盤と通信インフラを背景に、国家レベルの需要を見据えています。孫正義氏が語る「AIがAIを生む時代」を前提に、通信網そのものを知能化するLarge Telecom Modelは、海外クラウド依存からの脱却を強く意識した設計です。

| 企業 | 国産LLMの特徴 | 戦略の軸 |

|---|---|---|

| NTT | 軽量・高精度な日本語処理 | IOWNによる分散協調型AI |

| NEC | 高速推論と高信頼性 | 産業特化・実務ROI重視 |

| ソフトバンク | 超大規模・マルチモーダル | 計算規模による主権確立 |

これらに共通するのは、学習データや推論基盤を国内で完結させる設計思想です。文化庁や総務省の議論でも、生成AI時代におけるデータ越境と知的財産の管理は重要課題とされています。**国産LLMは性能競争だけでなく、法制度・産業構造と整合した「使えるAI」であることが最大の価値**となっています。

日本のAI戦略は、米国型の巨大プラットフォームとも、中国型の国家主導モデルとも異なります。現場実装と社会制度を同時に最適化するこの路線こそが、ソブリンAI時代における日本の競争優位を形づくりつつあります。

市場データで見る2026年のAI経済インパクト

2026年のAI経済インパクトを市場データから俯瞰すると、最大の特徴は「成長の質」が明確に変わった点にあります。Gartnerによれば、2026年の世界全体のAI支出額は約2兆5,270億ドルに達し、前年比44%増という高成長を維持しています。ただし、その内訳を見ると、実験的な導入や話題性先行の投資は減少し、**確実な収益や生産性向上に直結する分野へ資金が集中**していることが読み取れます。

特に注目すべきは、AIインフラへの支出が全体の過半を占めている点です。これは、AIモデルそのものよりも、それを安定的かつ大規模に動かす計算資源やデータセンターが、経済価値の源泉になっていることを示しています。ハイパースケーラー各社がGPUサーバーや電力・冷却設備に巨額投資を続けている背景には、AIが一時的なブームではなく、長期的な社会基盤になるという共通認識があります。

| 市場カテゴリ | 2026年支出額 | 前年比成長率 |

|---|---|---|

| AIインフラ | 約1兆3,660億ドル | 49% |

| AIソフトウェア | 約4,520億ドル | 60% |

| AIサービス | 約5,890億ドル | 34% |

| AIサイバーセキュリティ | 約513億ドル | 98% |

この中で最も成長率が高いのがAIサイバーセキュリティです。エージェンティックAIの普及により、AIが自律的に業務や取引を実行する場面が増えた結果、**誤作動や悪用が直接的な経済損失につながるリスク**が顕在化しました。そのため、AIを導入する企業ほど、防御や監査、ガバナンスへの投資を拡大するという逆説的な構図が生まれています。

日本市場に目を向けると、AI PCやエッジAIデバイスの普及が進む一方で、DRAMやSSDの供給不足による価格上昇が足かせとなり、導入スピードに濃淡が出ています。専門家の間では、**2026年は「AI需要は強いが、物理インフラが制約になる年」**と位置づけられており、AI投資がマクロ経済や製造業の供給網にまで影響を及ぼしている点は見逃せません。

総じて、2026年のAI経済インパクトは、単なる市場拡大ではなく、資本・インフラ・リスク管理を含めた総合力の競争へと移行しています。市場データが示しているのは、AIを導入するか否かではなく、**どの領域に、どの深さで投資できるかが企業価値を左右する時代に入った**という現実です。

エージェンティックAIが変える仕事の現場と産業構造

エージェンティックAIの本質的なインパクトは、単なる業務効率化ではなく、仕事の定義そのものを塗り替えつつある点にあります。従来のAIは人間の指示を待つ存在でしたが、2026年時点のエージェンティックAIは、目標を与えられると自ら計画を立て、必要なツールやシステムを横断的に操作し、結果が出るまで実行を続けます。人間は作業者から監督者・意思決定者へと役割を移し始めています。

この変化はホワイトカラー業務に顕著です。Gartnerによれば、2026年までに企業のデジタル業務の30%以上が「人間が関与しないエージェント主導プロセス」に置き換わるとされています。経理では月次決算の集計から異常検知、修正案提示までをAIエージェントが完結し、法務では契約レビューだけでなく交渉条件のシミュレーションまで担うケースが一般化しつつあります。

重要なのは、仕事が消えるのではなく「分解」される点です。定型的で再現性の高いタスクはAIエージェントに吸収され、人間は判断が分かれる部分や、組織全体への影響を考慮する役割に集中します。マイクロソフトの調査でも、AI導入企業ほど管理職の業務時間が戦略設計と人材育成に再配分されていることが示されています。

| 領域 | エージェンティックAIの役割 | 人間の役割 |

|---|---|---|

| 経営企画 | 市場分析・複数シナリオ生成 | 意思決定と責任の最終判断 |

| バックオフィス | 業務実行・例外処理の自動化 | ルール設計と監査 |

| 現場管理 | 進捗最適化・リソース配分 | 対人調整と価値判断 |

産業構造への影響も無視できません。エージェンティックAIは「人月型ビジネス」を根底から揺さぶっています。コンサルティング、IT受託開発、BPOといった分野では、成果物を納品するまでの大部分をAIエージェントが担えるようになり、価格は労働時間ではなく成果価値基準へ移行し始めています。これは中間業者の縮小と、少人数・高付加価値企業の台頭を同時に促しています。

日本では労働人口減少という構造課題と相まって、この変化が加速しています。NECのcotomi Actのように、AIエージェントが実際に社内システムへログインし、申請・支払い・契約処理を代行する事例は、「人がやらなくていい仕事」を現実的な規模で削減できることを示しました。結果として、1人あたりが担える業務範囲が拡張し、組織のスリム化と意思決定の高速化が同時に進んでいます。

一方で、すべてをAIに委ねる動きには慎重さも求められます。Gartnerは、エージェンティックAIの導入に成功している企業ほど、業務権限を細かく分割し、人間による承認ポイントを戦略的に残していると指摘しています。エージェンティックAIは「自律的に働く同僚」であり、完全な代替者ではありません。

仕事の現場では今後、「何をAIに任せ、どこに人間の判断を残すか」を設計できる人材の価値が急速に高まります。エージェンティックAIは産業を破壊する存在ではなく、仕事の重心をより知的で創造的な領域へ押し上げる触媒として、すでに現場と産業構造の深部に入り込み始めています。

ハルシネーション克服への技術革新と信頼性の確保

生成AIが実務の中核に入り込むにつれ、最大の障壁となってきたのがハルシネーションの問題です。2026年時点では、この課題に対して「精度向上」ではなく、信頼性を構造的に担保する技術革新が進んでいます。重要なのは、AIを賢くすることではなく、誤りに気づき、立ち止まれる仕組みを持たせる点にあります。

代表的な進展が、公衆衛生や医療分野で注目されているMEGA-RAGです。Frontiers in Public Healthに掲載された研究によれば、MEGA-RAGは多段階の検証プロセスを組み込むことで、従来型RAGと比較してハルシネーション率を40%以上削減しました。単一の検索結果に依存せず、複数の情報源を突き合わせる設計が、誤情報の混入を防いでいます。

| 観点 | 従来型RAG | MEGA-RAG |

|---|---|---|

| 情報取得 | 単一検索が中心 | 多源・知識グラフ併用 |

| 回答生成 | 単一案 | 複数案を生成 |

| 検証プロセス | 暗黙的 | 意味的一致を数値評価 |

このような設計思想の根底には、AI自身に「疑う役割」を与えるという発想があります。矛盾検知や自己修正のフェーズでは、AIが即答を避け、追加情報を求める挙動を取ります。これは、人間の専門家が不確実な状況で即断を避ける態度に近く、信頼性の質を大きく変える要素です。

さらに、根拠の透明性を評価するベンチマークも進化しています。ACLで公開されたRAGTruthは、回答がどの文書のどの表現に基づいているかを単語レベルで追跡します。これにより、企業はAIの出力をブラックボックスとして扱うのではなく、内部監査や説明責任に耐えうる形で評価できるようになりました。

OpenAIやGoogleが推進する最新モデルでも、この流れは顕著です。推論前に内部検証を行うThinking系アーキテクチャや、長文文脈を維持した整合性チェックは、単なる性能競争ではなく、誤りを最小化するための安全設計として位置づけられています。Gartnerも、今後のAI競争軸は精度ではなく信頼性になると指摘しています。

結果として、2026年のAIは「何でも答える存在」から、「答えられることと答えられないことを区別できる存在」へと進化しました。この変化こそが、医療、法務、金融といった高リスク領域でAIが本格活用される前提条件となり、社会全体の信頼を支える技術基盤になりつつあります。

AIガバナンスと倫理:企業と個人に求められる視点

AIが自律的に判断し、業務や社会インフラに深く関与する2026年において、AIガバナンスと倫理は「守りのルール」ではなく、価値創出の前提条件になっています。特にエージェンティックAIの普及により、誰がどこまで責任を負うのかという問いは、企業経営と個人利用の双方に突きつけられています。AIを導入しているだけで信頼を失う時代は終わり、どう統治しているかが評価軸になっています。

象徴的なのがEUのAI規則(AI Act)の全面施行です。欧州委員会の整理によれば、採用、融資、教育、医療などは高リスク領域に分類され、透明性、説明責任、継続的なリスク評価が義務付けられました。重要なのは、AIベンダー任せでは不十分で、導入企業自身が利用文脈に応じた検証を行う責任主体と明確に位置づけられた点です。

| 観点 | 企業に求められる対応 | 個人に求められる視点 |

|---|---|---|

| 透明性 | AI利用の目的・範囲・判断根拠の文書化 | AI生成物を鵜呑みにしない批判的理解 |

| 責任 | 人間による最終判断プロセスの設計 | 判断を完全委任しない意識 |

| 公平性 | バイアス検証と第三者監査 | 差別的出力への感度 |

ガートナーは、2026年末までにAIのガードレール不足に起因する重大な法的請求が2,000件を超えると予測しています。これは技術的欠陥というより、ガバナンス設計の欠如が原因とされています。高度なAIほど「何をさせないか」を決める設計思想が不可欠です。そのため多くの企業が、権限を最小化したエージェント運用や、操作ログの常時監査といったAgent Opsを導入しています。

一方、個人レベルでも倫理的視点は重要性を増しています。生成AIは文章や画像だけでなく、意思決定の補助に使われるようになりました。文化庁や国内有識者会議でも、AI利用時の著作権配慮や誤情報拡散への注意が繰り返し指摘されています。便利さの裏側で、判断力そのものを手放していないかを自問する姿勢が求められています。

最終的に、AIガバナンスと倫理はブレーキではなくハンドルです。適切な統治があってこそ、AIは安心して任せられるパートナーになります。信頼されるAIを設計・利用できるかどうかが、企業の競争力と個人の知的価値を分ける時代に入っています。

AGIは現実になるのか:専門家と経営者が描く未来像

AGIは本当に現実になるのか。この問いに対し、2026年時点の専門家と経営者の見解は、かつてないほど具体性を帯びています。議論の軸は「いつ誕生するか」ではなく、**すでに部分的なAGI的能力が現実の経済や組織で機能し始めている**という認識へと移行しています。

例えばOpenAIやGoogleの研究者が共通して指摘するのは、近年のフロンティアモデルが示す「汎用タスク適応力」です。数学、科学、プログラミング、業務判断といった異なる知的領域を、事前の個別学習なしに横断できる能力は、従来の特化型AIとは明確に一線を画します。スタンフォード大学のAI研究コミュニティでも、AGIを単一の到達点ではなく「連続的な能力の集合体」と捉える見方が主流になりつつあります。

経営者の視点は、さらに実利的です。ソフトバンクグループの孫正義氏は、AIが自らAIを設計・改善する循環に入ることで、数年以内に人間の知的生産性を桁違いに拡張すると繰り返し述べています。この発言は誇張として片付けられがちですが、背景には大規模資本、計算資源、データが同時に臨界点を超えつつあるという現実があります。

| 立場 | AGIへの見方 | 重視している要素 |

|---|---|---|

| AI研究者 | 段階的に到達する能力の総体 | 汎用推論、自己検証、転移学習 |

| テック企業経営者 | 経済を変える実用知能 | 自律性、スケーラビリティ、ROI |

| 政策・倫理専門家 | 制御すべき社会的存在 | ガバナンス、透明性、安全性 |

特に注目すべきは、「人間と同等かどうか」という比較軸が後退している点です。マイクロソフトの研究部門が示すレポートによれば、**AGIは人間の完全な代替ではなく、人間社会の意思決定構造に常時関与する知能**として定義され始めています。これは、経営判断、研究計画、政策立案といった領域にAIが深く入り込む未来像を意味します。

一方で慎重論も根強く存在します。Yann LeCun氏に代表される研究者は、現在のモデルは依然として世界モデルや常識理解が不十分であり、真のAGIには新しいアーキテクチャが必要だと述べています。この指摘は、AGIが「スケールの延長」だけでは到達できない可能性を示唆しています。

重要なのは、AGIが誕生するか否かではなく、**その過程で人間がどの段階から意思決定を委ね、どこに責任を残すのか**という設計です。専門家と経営者が描く未来像は楽観と警戒が交錯していますが、共通しているのは「AGIは議論の対象ではなく、準備すべき前提になりつつある」という認識です。

参考文献

- Gartner:Gartner Says Worldwide AI Spending Will Total $2.5 Trillion in 2026

- OpenAI:Introducing GPT-5.2

- Vertu:AI Model Releases Nov/Dec 2025: Gemini 3, Claude 4.5, GPT-5.2 Benchmarks & Comparison

- Microsoft Source:What’s Next in AI? 7 Key Trends Shaping 2026

- RelipaSoft:2026年のAIトレンド13選|日本企業が備えるべき最新AI動向と対策

- PR TIMES:造船・海洋産業向けAI基盤「AI Shipyard on IDX」を始動